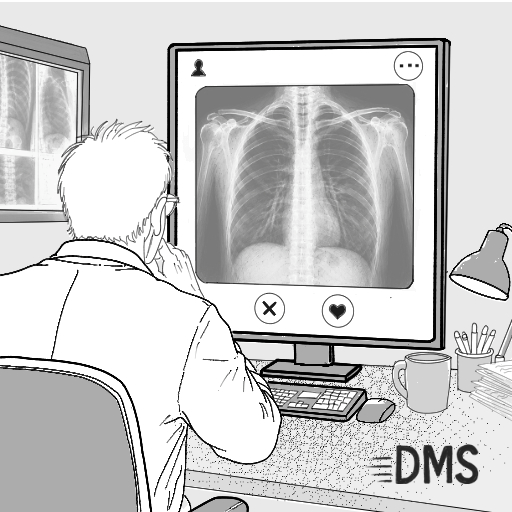

Dans son édito du 10 avril 2026, Tic Pharma a relayé une étude sur des clichés radiologiques générés par IA.👉 Seuls 41% des radiologues participant ont identifié la supercherie.👉 Informés, leur taux d’erreur est descendu à 25%👉 Les IA oscillent entre 15% et 44%.

Le sujet n’est pas la performance.

C’est le risque d’images altérées ou synthétiques.

Imaginez le scénario:

1️⃣ Génération d’une image crédible

2️⃣ Injection dans un dossier patient

3️⃣ Décision ou avis médical

Le médecin est responsable du bien fondé de ses prescriptions.

Le médecin expert judiciaire, des fautes commises dans sa mission.

Comment prouver qu’ils ont été abusés?

Leur faut-il se doter d’outils de détection?

Des outils dont la fiabilité reste limitée. Et qui interroge donc sur une responsabilité en cascade du prestataire.

🗣️ Mon conseil?

➡️ Tracer l’origine des images

➡️ Demander un avis expert en cas de doute

➡️ Sensibiliser les praticiens à ces nouveaux risques

La question n’est plus : « L’IA se trompe-t-elle ?«

Mais : A quoi peut-on encore faire confiance à l’ère de l’IA ?

Qu’en pensez-vous? Des RETEX, des craintes ou des outils de vérification? Partagez-les en commentaires.

Besoin d’un cadre opérationnel pour sécuriser ces usages ? Echangeons en MP.

Sources:

- The Rise of Deepfake Medical Imaging: Radiologists’ Diagnostic Accuracy in Detecting ChatGPT-generated Radiographs, Radiology, Volume 318, Number 3

- La bonne vieille radio doit bien se marrer, Tic Pharma, La newsletter hebdo du 10 avril 2026